打開新聞,無人機襲擊畫面不再罕見。背後推動這一切的,是快速迭代的人工智慧技術。當 AI 進入國防領域,改變的不只是武器威力,更是整個戰爭的邏輯與科技業的倫理底線。

什麼是「致命性自主武器系統」?

很多人聽到 AI 軍事應用,直覺想到遙控無人機。但真正的關鍵在於「自主」。傳統武器需要人類按下發射按鈕,自主武器系統(LAWS)則能透過演算法自行識別目標並決定攻擊。

根據國際紅十字會定義,這類系統一旦啟動,人類就無法介入干預。目前技術已能支援無人機群協同作戰,透過分散式網路同時處理大量戰場數據。反應速度從分鐘級壓縮到秒級,這意味著防禦系統必須比人類思考更快。

舉例來說,傳統防空系統需要雷達偵測、人員確認、指揮官下令,流程可能耗時 3 到 5 分鐘。導入 AI 後,系統自動辨識威脅並攔截,時間縮短至 10 秒以內。這種速度差異在現代戰爭中往往是生存與毀滅的關鍵。

科技大廠的倫理拉鋸戰

技術進步同時帶來爭議。2018 年,Google 員工發起抗議,反對公司參與 Pentagon 的 Project Maven 計畫,擔心演算法被用於無人機攻擊。最終 Google 承諾不開發用於監控或武器的 AI 技術。

Microsoft 則拿下五角大廈 100 億美元合約,但內部員工同樣發出公開信,要求高層重新評估倫理風險。這顯示科技人才對於技術應用的道德界線越來越敏感。對於台灣科技業來說,這不仅是倫理問題,更關係到人才招募與品牌形象。

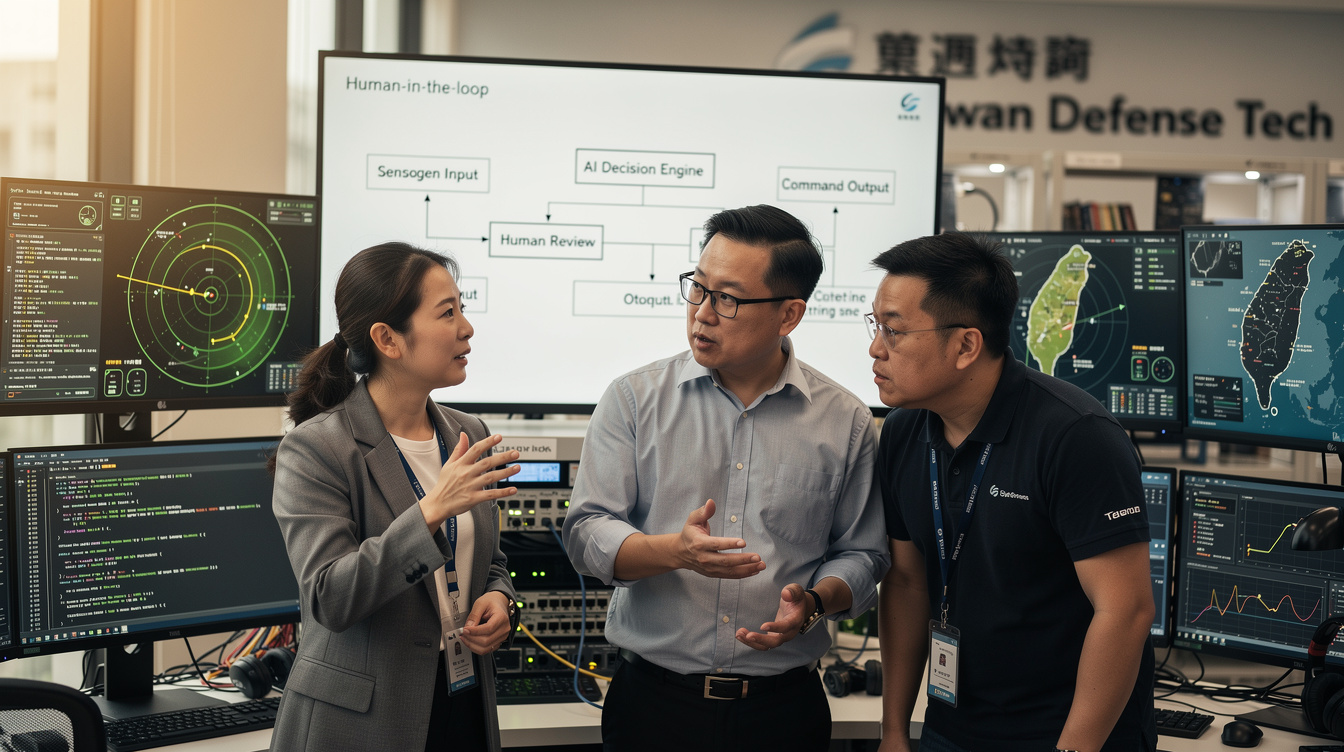

人類必須保持在迴路中

目前國際共識傾向「人類在迴路中」(Human-in-the-loop)。意思是最終開火決定權必須保留在人類手中。演算法可以提供建議、鎖定目標,但不能獨自扣下扳機。這道防線是防止誤判與濫殺的關鍵。

若完全交由 AI 決定,可能面臨演算法偏誤風險。例如訓練數據不足導致識別錯誤,將平民誤判為戰鬥人員。因此,多數民主國家國防政策仍堅持保留人類最終確認步驟。

台灣國防科技產業的機會

台灣擁有完整的半導體與電子供應鏈,這在智慧國防時代是關鍵優勢。無人機需要的晶片、感測器、通訊模組,台灣廠商都能提供。但如何平衡商業利益與國際倫理規範,是產業必須面對的課題。

國防部近年推動「智慧國防」,預算逐年增加。民間科技公司与軍方合作時,需明確界定技術用途。是用於後勤維護?還是前線識別?界線模糊可能引發國際制裁或消費者抵制。

給科技從業人員的建議

- 審視合約條款:加入國防相關專案前,確認技術最終應用場景。

- 關注倫理規範:參考 IEEE 或 ACM 制定的 AI 倫理準則。

- 保留否決權:確保系統設計中有人類介入的機制。

技術本身沒有善惡,但使用技術的人有。當 AI 能力越來越強,科技從業人員的責任也隨之加重。下一次面對國防相關專案時,不妨多問一句:這套系統的最終決定權在哪裡?

現在就打開你的筆記本,檢視手邊專案是否有潛在的倫理風險。